|

Ш§ЩҶШ¬Щ…ЩҶ ШұШ§ ШҜШұ ЪҜЩҲЪҜЩ„ Щ…ШӯШЁЩҲШЁ Ъ©ЩҶЩҠШҜ :

|

|||||||

| Ш«ШЁШӘ ЩҶШ§Щ… | Ш§ШұШіШ§Щ„ ШҜШ№ЩҲШӘЩҶШ§Щ…ЩҮ ШЁЩҮ ШҜЩҲШіШӘШ§ЩҶ ! | ШұШ§ЩҮЩҶЩ…Ш§ЩҠ ШіШ§ЩҠШӘ | Community | ШӘЩӮЩҲЩҠЩ… | Ш§ШұШіШ§Щ„ЩҮШ§ЩҠ Ш§Щ…ШұЩҲШІ | Ш¬ШіШӘШ¬ЩҲ |

|

| ШӘШЁЩ„ЩҠШәШ§ШӘ ШіШ§ЩҠШӘ | |||||||||||||||||||||||||||||||

|

|

|

LinkBack | Ш§ШЁШІШ§ШұЩҮШ§ЩҠ ШӘШ§ЩҫЩҠЪ© | ЩҶШӯЩҲЩҮ ЩҶЩ…Ш§ЩҠШҙ |

|

|

#1 (Щ„ЫҢЩҶЪ© ШҜШ§ШҰЩ…) |

|

Administrator

|

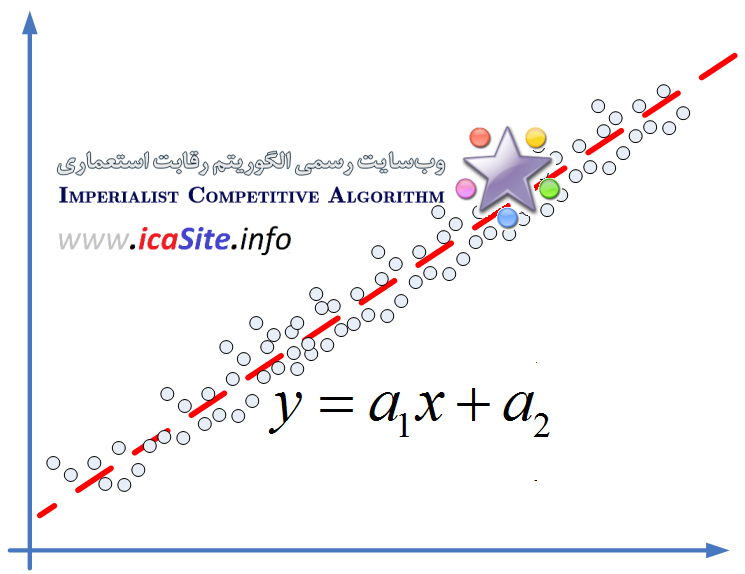

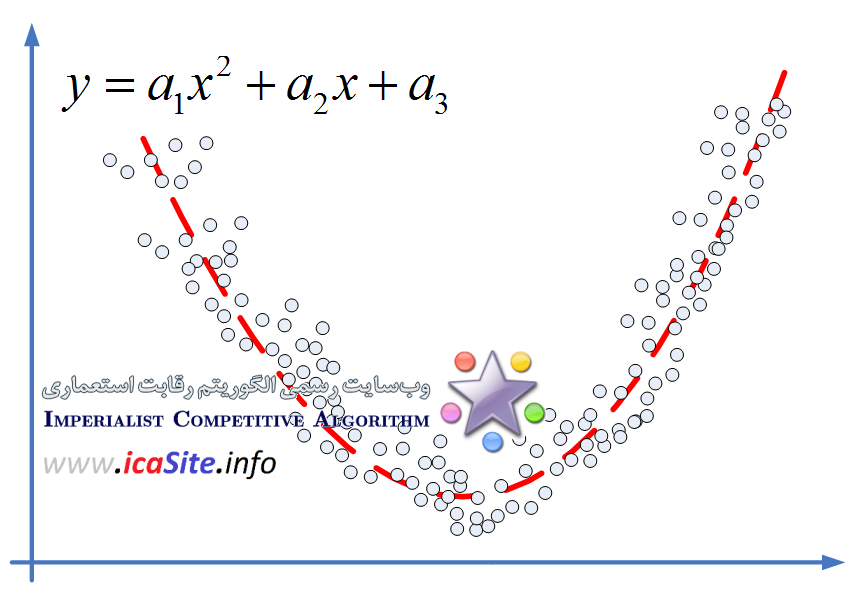

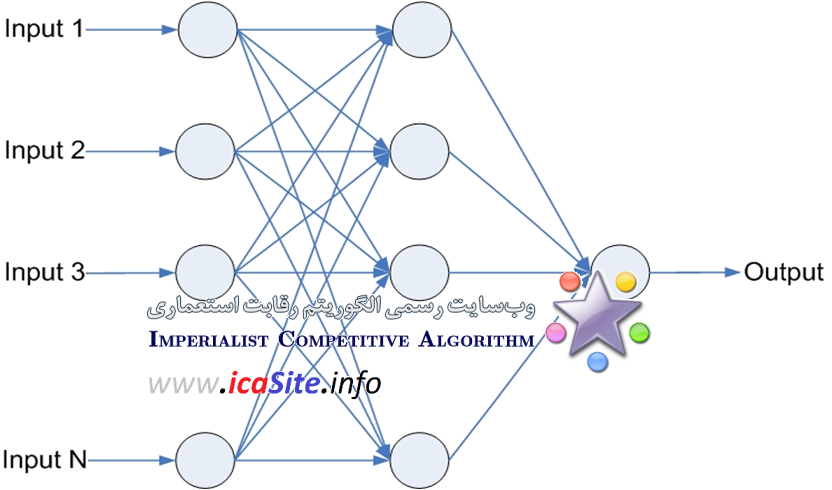

ЫҢШ§ШҜЪҜЫҢШұЫҢ ШҙШЁЪ©ЩҮ Ш№ШөШЁЫҢ ШЁШ§ Ш§ШіШӘЩҒШ§ШҜЩҮ Ш§ШІ Ш§Щ„ЪҜЩҲШұЫҢШӘЩ… ШұЩӮШ§ШЁШӘ Ш§ШіШӘШ№Щ…Ш§ШұЫҢ

Ш§ЩҠЩҶ ЩҫШіШӘ Ш§ШІ ЩҲШЁШіШ§ЩҠШӘ Щ…ШӯШ§ШіШЁШ§ШӘ ШӘЪ©Ш§Щ…Щ„ЫҢ ЩҲ Ш§Щ„ЪҜЩҲШұЫҢШӘЩ… ШұЩӮШ§ШЁШӘ Ш§ШіШӘШ№Щ…Ш§ШұЫҢ Щ…ЩҠШЁШ§ШҙШҜ.ЩҫШі ШЁШұШ§ЩҠ Щ…Ш·Ш§Щ„Ш№ЩҮ ШЁЩҠШҙШӘШұ ШЁЩҮ Щ…ЩҶШЁШ№ ШўЩҶ Щ…ШұШ§Ш¬Ш№ЩҮ Ъ©ЩҶЩҠШҜ.  Щ…ЩӮШҜЩ…ЩҮ ЩҫШіШӘЫҢ Ъ©ЩҮ ШҜШұ Ш§ШҜШ§Щ…ЩҮ Щ…ЫҢ Ш®ЩҲШ§ЩҶЫҢШҜШҢ ШЁЩҮ ЫҢШ§ШҜЪҜЫҢШұЫҢ ШҙШЁЪ©ЩҮ Ш№ШөШЁЫҢ ШЁШ§ Ш§ШіШӘЩҒШ§ШҜЩҮ Ш§ШІ Ш§Щ„ЪҜЩҲШұЫҢШӘЩ… ШұЩӮШ§ШЁШӘ Ш§ШіШӘШ№Щ…Ш§ШұЫҢ Щ…ЫҢ ЩҫШұШҜШ§ШІШҜ. Ш§Щ„ШЁШӘЩҮ Щ…Ш·Ш§Щ„ШЁ Ш§ШұШ§ШҰЩҮ ШҙШҜЩҮ Ш№Щ…ЩҲЩ…ЫҢ ШЁЩҲШҜЩҮ ЩҲ ШҙШ§Щ…Щ„ Ш§ШіШӘЩҒШ§ШҜЩҮ Ш§ШІ Ш§Щ„ЪҜЩҲШұЫҢШӘЩ… ЩҮШ§ЫҢ ШҜЫҢЪҜШұЫҢ ЩҮЩ…ЪҶЩҲЩҶ Ш§Щ„ЪҜЩҲШұЫҢШӘЩ… ЪҳЩҶШӘЫҢЪ© ЫҢШ§ GA (Genetic Algorithms)ШҢ Ш§Щ„ЪҜЩҲШұЫҢШӘЩ… Ш§ШІШҜШӯШ§Щ… Ш°ШұШ§ШӘ ЫҢШ§ PSO (Particle Swarm Optimization) ЩҲ ШҙШЁЫҢЩҮ ШіШ§ШІЫҢ ШӘШЁШұЫҢШҜ ЩҒЩ„ШІШ§ШӘ ЫҢШ§ SA (Simulated Annealing) ЩҶЫҢШІ Ш®ЩҲШ§ЩҮШҜ ШҙШҜ. ШӯШӘЫҢ ШЁЩҮ ЩҶШёШұ Щ…ЫҢ ШұШіШҜ Ъ©ЩҮ Ш§ШіШӘЩҒШ§ШҜЩҮ Ш§ШІ ЩҮШұ ЫҢЪ© Ш§ШІ Ш№ЩҶШ§ЩҲЫҢЩҶ ШІЫҢШұ ШЁШұШ§ЫҢ Ш§ЫҢЩҶ ЩҫШіШӘ Щ…ЩҶШ§ШіШЁ ШЁЩҲШҜ. ШўЩ…ЩҲШІШҙ ШҙШЁЪ©ЩҮ Ш№ШөШЁЫҢ (Neural Network Training) ШӘЩҲШіШ· Ш§Щ„ЪҜЩҲШұЫҢШӘЩ… ШұЩӮШ§ШЁШӘ Ш§ШіШӘШ№Щ…Ш§ШұЫҢ (Imperialist Competitive Algorithm) ШўЩ…ЩҲШІШҙ (ШӘШ№ЫҢЫҢЩҶ ЩҲШІЩҶЩҮШ§ЫҢ) ШҙШЁЪ©ЩҮ Ш№ШөШЁЫҢ (Neural Network Training) ШӘЩҲШіШ· Ш§Щ„ЪҜЩҲШұЫҢШӘЩ… ЩҮШ§ЫҢ ШӘЪ©Ш§Щ…Щ„ЫҢ (Evolutionary Algorithms) ШўЩ…ЩҲШІШҙ (ШӘШ№ЫҢЫҢЩҶ ЩҲШІЩҶЩҮШ§ЫҢ) ШҙШЁЪ©ЩҮ Ш№ШөШЁЫҢ (Neural Network Training) ШӘЩҲШіШ· Ш§Щ„ЪҜЩҲШұЫҢШӘЩ… ЪҳЩҶШӘЫҢЪ© (Genetic Algorithms) ШўЩ…ЩҲШІШҙ (ШӘШ№ЫҢЫҢЩҶ ЩҲШІЩҶЩҮШ§ЫҢ) ШҙШЁЪ©ЩҮ Ш№ШөШЁЫҢ (Neural Network Training) ШӘЩҲШіШ· Ш§Щ„ЪҜЩҲШұЫҢШӘЩ… ЩҫШұЩҶШҜЪҜШ§ЩҶ ЫҢШ§ Ш§Щ„ЪҜЩҲШұЫҢШӘЩ… Ш§ШІШҜШӯШ§Щ… Ш°ШұШ§ШӘ (Particle Swarm Optimization) ШўЩ…ЩҲШІШҙ (ШӘШ№ЫҢЫҢЩҶ ЩҲШІЩҶЩҮШ§ЫҢ) ШҙШЁЪ©ЩҮ Ш№ШөШЁЫҢ (Neural Network Training) ШӘЩҲШіШ· Ш§Щ„ЪҜЩҲШұЫҢШӘЩ… ШӘШЁШұЫҢШҜ ЩҒЩ„ШІШ§ШӘ ШҙШЁЫҢЩҮ ШіШ§ШІЫҢ ШҙШҜЩҮ (Simulated Annealing) ШҙШЁЪ©ЩҮ Ш№ШөШЁЫҢ ЩӮШЁЩ„ Ш§ШІ ШҙШұЩҲШ№ ШЁШӯШ«ШҢ Щ…ШұЩҲШұЫҢ Ъ©ЩҲШӘШ§ЩҮ ШЁШұ ШҙШЁЪ©ЩҮ ЩҮШ§ЫҢ Ш№ШөШЁЫҢ Ш®ЩҲШ§ЩҮЫҢЩ… ШҜШ§ШҙШӘ. Ш§Щ„ШЁШӘЩҮ ШЁЩҮ ШІЩҲШҜЫҢ ЫҢЪ© ЩҒЫҢЩ„Щ… Ш¬Ш§Щ…Ш№ ШҜШұ Щ…ЩҲШұШҜ ШўЩ…ЩҲШІШҙ Ш№Щ…Щ„ЫҢ ШҙШЁЪ©ЩҮ ШЁЩҮ ШІШЁШ§ЩҶ ШіШ§ШҜЩҮ ШҜШұ ЩҮЩ…ЫҢЩҶ ШіШ§ЫҢШӘ (ШЁЩҮЫҢЩҶЩҮ ШіШ§ШІЫҢ ШӘЪ©Ш§Щ…Щ„ЫҢ ЩҲ Ш§Щ„ЪҜЩҲШұЫҢШӘЩ… ШұЩӮШ§ШЁШӘ Ш§ШіШӘШ№Щ…Ш§ШұЫҢ) Ш№ШұШ¶ЩҮ Ш®ЩҲШ§ЩҮШҜ ШҙШҜ. Ш¬ЩҮШӘ Щ…Ш·Щ„Ш№ ШҙШҜЩҶ Ш§ШІ Ш№ШұШ¶ЩҮ ШҙШҜЩҶ Ш§ЫҢЩҶ Щ…ШӯШөЩҲЩ„ШҢ ШҜШұ Ш®ШЁШұЩҶШ§Щ…ЩҮ Ш§ЫҢЩ…ЫҢЩ„ЫҢ Щ…Ш§ Ш№Ш¶ЩҲ ШҙЩҲЫҢШҜ (Ш§ЫҢЩҶ Щ„ЫҢЩҶЪ©). ШҙШЁЪ©ЩҮ Ш№ШөШЁЫҢ ЩҒШ§ШұШә Ш§ШІ ШӯЩҲШ§ШҙЫҢ ШўЩҶ Ъ©ЩҮ ШЁЩҮ ШЁШӯШ« ЩҶЩҲШұЩҲЩҶ ЩҲ ШіЫҢЩҶШ§ЩҫШі ЩҲ ... (Ъ©Щ„ЫҢ Ш§ШІ Ш§ЫҢЩҶ Щ„ШәШӘ ЩҮШ§) Ш§ШұШӘШЁШ§Ш· ШҜШ§ШұШҜ (Ъ©ЩҮ Ш§ШІ ШҜЫҢШҜЪҜШ§ЩҮ Щ…ЩҶ Ш§ШөЩ„Ш§ЩӢ ШұШЁШ·ЫҢ ЩҶШҜШ§ШұШҜ) ЫҢЪ© Ш§ШЁШІШ§Шұ ШЁШұШ§ЫҢ ШӘЩӮШұЫҢШЁ ШӘШ§ШЁШ№ (Function Approximation) Ш§ШіШӘ. Щ…Ш§ ШЁШ§ Ш§ШЁШІШ§ШұЩҮШ§ЫҢ ШіШ§ШҜЩҮ ШӘЩӮШұЫҢШЁ ШӘШ§ШЁШ№ШҢ Щ…Ш«Щ„ ЪҶЩҶШҜ Ш¬Щ…Щ„ЩҮ Ш§ЫҢ ЩҮШ§ ШўШҙЩҶШ§ ЩҮШіШӘЫҢЩ…. Щ…Ш«Щ„Ш§ЩӢ ШұШ§ШЁШ·ЩҮ y=ax+b ЫҢЪ© Ш®Ш· ШұШ§ ЩҶШҙШ§ЩҶ Щ…ЫҢ ШҜЩҮШҜ. ЫҢЪ© Щ…Ш«Ш§Щ„ Ш§ШІ ШӘЩӮШұЫҢШЁ Ш®Ш·ЫҢ ШұШ§ ШҜШұ ШҙЪ©Щ„ ШІЫҢШұ Щ…ЫҢ ШЁЫҢЩҶЫҢЩ…. Ш§ЫҢЩҶ Ш®Ш· 2 ЩҫШ§ШұШ§Щ…ШӘШұ a ЩҲ b ШҜШ§ШұШҜ. Ш§ЪҜШұ Щ…Ш§ Щ…Ш¬Щ…ЩҲШ№ЩҮ Ш§ЫҢ Ш§ШІ ЩҶЩӮШ§Ш· ШҜШ§ШҙШӘЩҮ ШЁШ§ШҙЫҢЩ… ЩҲ ШЁШ®ЩҲШ§ЩҮЫҢЩ… ШЁЩҮШӘШұЫҢЩҶ Ш®Ш· ЪҜШ°ШұЩҶШҜЩҮ Ш§ШІ Ш§ЫҢЩҶ ЩҶЩӮШ§Ш· ШұШ§ ЩҫЫҢШҜШ§ Ъ©ЩҶЫҢЩ…ШҢ ШЁШ§ЫҢШҜ ЫҢЪ© Ш¬ШіШӘШ¬ЩҲ ШЁШұШ§ЫҢ ЫҢШ§ЩҒШӘЩҶ ШЁЩҮШӘШұЫҢЩҶ a ЩҲ b Ш§ЩҶШ¬Ш§Щ… ШҜЩҮЫҢЩ…. ЩҮЩ…ЫҢЩҶ Ъ©ЩҮ Ъ©Щ„Щ…ЩҮ Ш¬ШіШӘШ¬ЩҲ ШұШ§ ШЁШұ ШІШЁШ§ЩҶ Ш®ЩҲШҜ Ш¬Ш§ШұЫҢ ШіШ§Ш®ШӘЫҢЩ…! ЫҢШ№ЩҶЫҢ ШЁЩҮ ЫҢЪ© Ш§ШЁШІШ§Шұ Ш¬ШіШӘШ¬ЩҲ ЩҶЫҢШ§ШІ ШҜШ§ШұЫҢЩ…. ШіШ§ШҜЩҮ ШӘШұЫҢЩҶ ШұЩҲШҙ Ш¬ШіШӘШ¬ЩҲ Ш§ЫҢЩҶ Ш§ШіШӘ Ъ©ЩҮ ЩҮШұ a ЩҲ b Щ…Щ…Ъ©ЩҶ ШұШ§ Ъ©ЩҮ ШЁЩҮ Ш°ЩҮЩҶЩ…Ш§ЩҶ Щ…ЫҢ ШұШіШҜШҢ Ш§Щ…ШӘШӯШ§ЩҶ Ъ©ЩҶЫҢЩ… (Ш¬ШіШӘШ¬ЩҲЫҢ Ш¬Ш§Щ…Ш№)! ЫҢШ№ЩҶЫҢ Ш®Ш·ЩҲШ· Щ…Ш®ШӘЩ„ЩҒ ШӘШҙЪ©ЫҢЩ„ ШҙШҜЩҮ ШЁШ§ Ш§ЫҢЩҶ a ЩҲ b Щ…Ш®ШӘЩ„ЩҒ ШұШ§ ШӘШұШіЫҢЩ… Щ…ЫҢ Ъ©ЩҶЫҢЩ… ЩҲ Ш®Ш·ЫҢ Ъ©ЩҮ ШЁЫҢШҙШӘШұЫҢЩҶ Ш№ШЁЩҲШұ (ШЁШұШ§ШІШҙ) ШұШ§ ШҜШ§ШҙШӘЩҮ ШЁШ§ШҙШҜШҢ Ш§ЩҶШӘШ®Ш§ШЁ Щ…ЫҢ Ъ©ЩҶЫҢЩ…. ЩҮЩ…ЫҢЩҶ. Ш§Щ„ШЁШӘЩҮ Ш§ШөЩ„Ш§ЩӢ ШҜШұ Щ…ЩҲШұШҜ ШЁШұШ§ШІШҙ Ш®Ш· Ш§ШөЩ„Ш§ЩӢ ЩҶЫҢШ§ШІЫҢ ШЁЩҮ Ш§ЫҢЩҶ ЩҮЩ…ЩҮ Ш§ЩҶШұЪҳЫҢ ЪҜШ°Ш§ШҙШӘЩҶ ЩҶЫҢШіШӘ! Ш¬ЩҲШ§ШЁ Щ…ШіШҰЩ„ЩҮ ШұШ§ ШҜЩҲШіШӘШ§ЩҶ ШұЫҢШ§Ш¶ЫҢ Ъ©Ш§Шұ ШӯЩ„ Ъ©ШұШҜЩҮ Ш§ЩҶШҜ ЩҲ ШӘШұ ЩҲ ШӘЩ…ЫҢШІ ШҜШұ Ш§Ш®ШӘЫҢШ§Шұ ЪҜШ°Ш§ШҙШӘЩҮ Ш§ЩҶШҜ. Щ…Ш«Щ„Ш§ЩӢ Ш§ЫҢЩҶ Щ„ЫҢЩҶЪ© ЩҲЫҢЪ©ЫҢЩҫШҜЫҢШ§ ШұШ§ ШЁШЁЫҢЩҶЫҢШҜ.  ШҙЪ©Щ„ 1: ШЁШұШ§ШІШҙ Ш®Ш·ЫҢ ШӘШ№ШҜШ§ШҜ ЩҶЩӮШ·ЩҮ. ШҜШұ Ш§ЫҢЩҶ ШҙЪ©Щ„ ШЁЩҮШӘШұЫҢЩҶ Ш®Ш· Ш№ШЁЩҲШұЫҢ Ш§ШІ Щ…ЫҢШ§ЩҶ Ш§ЫҢЩҶ ЩҶЩӮШ§Ш· ШӘШұШіЫҢЩ… ШҙШҜЩҮ Ш§ШіШӘ. ШӯШ§Щ„Ш§ Ш§ЪҜШұ ЩҶЩӮШ§Ш· Щ…Ш§ ШҜШұ ШӯШ§Щ„ШӘЫҢ Щ…Ш«Щ„ ШіЩҮЩ…ЫҢ ЩӮШұШ§Шұ ЪҜШұЩҒШӘЩҮ ШЁЩҲШҜЩҶШҜ ЪҶЩҮ ШЁШ§ЫҢШҜ Ъ©ШұШҜШҹ ЩҮЫҢЪҶ Ъ©Ш§ШұЫҢ! ШұШ§ШЁШ·ЩҮ ШЁШ§Щ„Ш§ ШұШ§ ШЁЩҮ ШөЩҲШұШӘ Ш¬Ш§Щ…Ш№ШӘШұ (y=ax^2+bx+c) ШұШ§ШЁШ·ЩҮ ШіЩҮЩ…ЫҢ Щ…ЫҢ ЩҶЩҲЫҢШіЫҢЩ… ЩҲ ШЁЩҮ ШҜЩҶШЁШ§Щ„ ШіЩҮ ЩҫШ§ШұШ§Щ…ШӘШұ Щ…ЩҶШ§ШіШЁ ШЁШұШ§ЫҢ a ЩҲ b ЩҲ c Щ…ЫҢ ЪҜШұШҜЫҢЩ…. Ш®ЩҲШҙШЁШ®ШӘШ§ЩҶЩҮ Ш¬ЩҲШ§ШЁ Ш§ЫҢЩҶ ШӯШ§Щ„ШӘ (Ъ©Щ„Ш§ЩӢ ЪҶЩҶШҜ Ш¬Щ…Щ„ЩҮ Ш§ЫҢ Ш§ШІ ЩҮШұ ШҜШұШ¬ЩҮ Ш§ЫҢ) ЩҶЫҢШІ ШЁШөЩҲШұШӘ ШӘШӯЩ„ЫҢЩ„ЫҢ ЩҲШ¬ЩҲШҜ ШҜШ§ШұШҜ. ШҙЪ©Щ„ ШІЫҢШұШҢ ШЁШұШ§ШІШҙ Щ…ЩҶШӯЩҶЫҢ ШЁШ§ Ш§ШіШӘЩҒШ§ШҜЩҮ Ш§ШІ ЫҢЪ© Щ…Ш№Ш§ШҜЩ„ЩҮ ШіЩҮЩ…ЫҢ ШұШ§ ЩҶШҙШ§ЩҶ Щ…ЫҢ ШҜЩҮШҜ.  ШҙЪ©Щ„ 2: ШЁШұШ§ШІШҙ ШӘШ№ШҜШ§ШҜ ЩҶЩӮШ·ЩҮ ШӘЩҲШіШ· Щ…Ш№Ш§ШҜЩ„ЩҮ Щ…ШұШӘШЁЩҮ ШҜЩҲ. ШҜШұ Ш§ЫҢЩҶ ШҙЪ©Щ„ ШЁЩҮШӘШұЫҢЩҶ ШіЩҮЩ…ЫҢ Ш№ШЁЩҲШұЫҢ Ш§ШІ Щ…ЫҢШ§ЩҶ Ш§ЫҢЩҶ ЩҶЩӮШ§Ш· ШӘШұШіЫҢЩ… ШҙШҜЩҮ Ш§ШіШӘ. Ш§ЪҜШұ ШұШ§ШЁШ·ЩҮ ЩҫЫҢЪҶЫҢШҜЩҮ ШҙШҜШҢ ЪҶЩҮ ШЁШ§ЫҢШҜ Ъ©ШұШҜШҹ Ш§ЫҢЩҶ ШЁШ§Шұ ШҜШұ Ъ©ЩҶШ§Шұ ШұЩҲШҙЩҮШ§ЫҢ ШҜЫҢЪҜШұ (Щ…Ш«Щ„Ш§ЩӢ ЪҶЩҶШҜ Ш¬Щ…Щ„ЩҮ Ш§ЫҢ ЩҮШ§ЫҢ ШҜШұШ¬ЩҮ ШЁШ§Щ„Ш§ШӘШұ Ъ©ЩҮ Ъ©Щ… Ъ©Щ… Ъ©Ш§ШұШ§ЫҢЫҢ Ш®ЩҲШҜ ШұШ§ Ш§ШІ ШҜШіШӘ Ш®ЩҲШ§ЩҮЩҶШҜ ШҜШ§ШҜ)ШҢ ШҙШЁЪ©ЩҮ Ш№ШөШЁЫҢ ЩҶЫҢШІ Щ…ЩҒЫҢШҜ Ш®ЩҲШ§ЩҮШҜ ШЁЩҲШҜ. ШЁШ§ Ш§ЫҢЩҶ ШұЩҲЩҶШҜ ШЁШ§ЫҢШҜ ШҙЩ…Ш§ ЩҮЩ… Щ…Ш«Щ„ Щ…ЩҶ ШЁЩҮ Ш§ЫҢЩҶ ЩҶШӘЫҢШ¬ЩҮ ШұШіЫҢШҜЩҮ ШЁШ§ШҙЫҢШҜШҢ Ъ©ЩҮ ШҙШЁЪ©ЩҮ Ш№ШөШЁЫҢ ЫҢЪ© ШұШ§ШЁШ·ЩҮ ЩҲ Ш§ШұШӘШЁШ§Ш· ШЁЫҢЩҶ ЩҲШұЩҲШҜЫҢ ЩҲ Ш®ШұЩҲШ¬ЫҢ Ш§ШіШӘ. ШЁЩҮ Ш№ШЁШ§ШұШӘ ШҜЫҢЪҜШұ ШҙШЁЪ©ЩҮ Ш№ШөШЁЫҢ ЪҶЫҢШІЫҢ ЩҶЫҢШіШӘ ШЁЩҮ Ш¬ШІ ЫҢЪ© ШӘШ§ШЁШ№ ШіШ§ШҜЩҮ! ШҙЪ©Щ„ ШІЫҢШұ ШіШ§Ш®ШӘШ§Шұ ЫҢЪ© ШҙШЁЪ©ЩҮ Ш№ШөШЁЫҢ ЩҫШұШіЩҫШӘШұЩҲЩҶ ЪҶЩҶШҜ Щ„Ш§ЫҢЩҮ ШұШ§ ШЁЩҮ ЩҮЩ…ШұШ§ЩҮ ШіШ§Ш®ШӘШ§Шұ ЫҢЪ© ЩҶШұЩҲЩҶ ЩҶШҙШ§ЩҶ Щ…ЫҢ ШҜЩҮШҜ. Ш§ЫҢЩҶ ШҙШЁЪ©ЩҮ Ш№ШөШЁЫҢ ШҜШ§ШұШ§ЫҢ N ШӘШ§ ЩҲШұЩҲШҜЫҢ ЩҲ ЫҢЪ© Ш®ШұЩҲШ¬ЫҢ Ш§ШіШӘ.  ШҙЪ©Щ„ 3: ШіШ§Ш®ШӘШ§Шұ ЫҢЪ© ШҙШЁЪ©ЩҮ Ш№ШөШЁЫҢ ЩҫШұШіЩҫШӘШұЩҲЩҶ ЪҶЩҶШҜ Щ„Ш§ЫҢЩҮ  ШҙЪ©Щ„ 4: ШіШ§Ш®ШӘШ§Шұ ЫҢЪ© ЩҶШұЩҲЩҶ Щ…ЩҲШұШҜ Ш§ШіШӘЩҒШ§ШҜЩҮ ШҜШұ ШіШ§Ш®ШӘШ§Шұ ШҙЪ©Щ„ 3 ЩҮШұ ШӘШ§ШЁШ№ЫҢ Ъ©ЩҮ ШЁШұШ§ЫҢ ШЁШұШ§ШІШҙ Щ…ЩҶШӯЩҶЫҢ Ш§ШіШӘЩҒШ§ШҜЩҮ Щ…ЫҢ ШҙЩҲШҜШҢ ЩҫШ§ШұШ§Щ…ШӘШұЩҮШ§ЫҢЫҢ ШҜШ§ШұШҜ. ШҙШЁЪ©ЩҮ Ш№ШөШЁЫҢ ЩҮЩ… Ш§ШІ Ш§ЫҢЩҶ ЩҫШ§ШұШ§Щ…ШӘШұЩҮШ§ (ШўЩҶЩҮЩ… ШЁЩҮ ШӘШ№ШҜШ§ШҜ ШІЫҢШ§ШҜ) ШҜШ§ШұШҜ. Щ…Ш§ Щ…Ш¬Щ…ЩҲШ№ЩҮ ШўЩҶЩҮШ§ ШұШ§ ШЁШ§ W ЩҶШҙШ§ЩҶ Щ…ЫҢ ШҜЩҮЫҢЩ…. ШЁШұШ§ЫҢ ШҙШЁЪ©ЩҮ Ш№ШөШЁЫҢ ШӯЩ„ ШЁШіШӘЩҮ ЩҲ ШіШ§ШҜЩҮ ЩҲШ¬ЩҲШҜ ЩҶШҜШ§ШұШҜ. ЫҢЪ© ШұЩҲШҙ Щ…ЩҲШұШҜ Ш§ШіШӘЩҒШ§ШҜЩҮШҢ ШұЩҲШҙ ЩҫШі Ш§ЩҶШӘШҙШ§Шұ Ш®Ш·Ш§ (Error Back-Propagation) Щ…ЫҢ ШЁШ§ШҙШҜ. Ш§ЫҢЩҶ ШұЩҲШҙ Ш§ШІ ШӘЪ©ЩҶЫҢЪ© ЩҮШ§ЫҢ ШЁЩҮЫҢЩҶЩҮ ШіШ§ШІЫҢ Щ…ШЁШӘЩҶЫҢ ШЁШұ ЪҜШұШ§ШҜЫҢШ§ЩҶ (Gradient-Based Methods) ШЁШұШ§ЫҢ ЫҢШ§ЩҒШӘЩҶ W Ш§ШіШӘЩҒШ§ШҜЩҮ Щ…ЫҢ Ъ©ЩҶШҜ. Щ…ЩҶШӘЩҮШ§ Ш§ЫҢЩҶ ШӘЩҶЩҮШ§ ШұЩҲШҙ ЩҶЫҢШіШӘ. ШұЩҲШҙЩҮШ§ЫҢ ШЁЩҮЫҢЩҶЩҮ ШіШ§ШІЫҢ ШӘЪ©Ш§Щ…Щ„ЫҢ ЩҶЫҢШІ ШЁШұШ§ЫҢ Ш§ЫҢЩҶ Щ…ЩҶШёЩҲШұ Ш§ШіШӘЩҒШ§ШҜЩҮ Щ…ЫҢ ШҙЩҲЩҶШҜ. Ш§Щ„ЪҜЩҲШұЫҢШӘЩ… ШұЩӮШ§ШЁШӘ Ш§ШіШӘШ№Щ…Ш§ШұЫҢ Ш§Щ„ЪҜЩҲШұЫҢШӘЩ… ШұЩӮШ§ШЁШӘ Ш§ШіШӘШ№Щ…Ш§ШұЫҢ (Imperialist Competitive Algorithm) Ъ©ЩҮ ШЁЩҮ Ш§Ш®ШӘШөШ§Шұ ICA ЩҶШ§Щ…ЫҢШҜЩҮ Щ…ЫҢ ШҙЩҲШҜШҢ ЫҢЪ©ЫҢ Ш§ШІ Ш¬ШҜЫҢШҜ ШӘШұЫҢЩҶ Ш§Щ„ЪҜЩҲШұЫҢШӘЩ… ЩҮШ§ЫҢ ШЁЩҮЫҢЩҶЩҮ ШіШ§ШІЫҢ ШӘЪ©Ш§Щ…Щ„ЫҢ Ш§ШіШӘ. Ш§ЫҢЩҶ Ш§Щ„ЪҜЩҲШұЫҢШӘЩ… ЩҮЩ…Ш§ЩҶЪҜЩҲЩҶЩҮ Ъ©ЩҮ Ш§ШІ ЩҶШ§Щ… ШўЩҶ ШЁШұ Щ…ЫҢ ШўЫҢШҜШҢ ШЁШұ Щ…ШЁЩҶШ§ЫҢ Щ…ШҜЩ„ШіШ§ШІЫҢ ЩҒШұШ§ЫҢЩҶШҜ Ш§Ш¬ШӘЩ…Ш§Ш№ЫҢ ШіЫҢШ§ШіЫҢ ЩҫШҜЫҢШҜЩҮ Ш§ШіШӘШ№Щ…Ш§Шұ ШЁЩҶШ§ ЩҶЩҮШ§ШҜЩҮ ШҙШҜЩҮ Ш§ШіШӘ. Ш§ШІ Ш§ЫҢЩҶ Ш¬ЩҮШӘ ШҜШұ ЩҶЩҲШ№ Ш®ЩҲШҜ ЫҢЪ© Ш§Щ„ЪҜЩҲШұЫҢШӘЩ… Ш¬ШҜЫҢШҜ ШЁЩҲШҜЩҮ ЩҲ ЩӮШ§ШЁЩ„ ШұЩӮШ§ШЁШӘ ШЁШ§ ШіШ§ЫҢШұ Ш§Щ„ЪҜЩҲШұЫҢШӘЩ… ЩҮШ§ЫҢ ШӘЪ©Ш§Щ…Щ„ЫҢ Ш§ШІ Ш¬Щ…Щ„ЩҮ Ш§Щ„ЪҜЩҲШұЫҢШӘЩ… ЩҮШ§ЫҢ ЪҳЩҶШӘЫҢЪ©ШҢ Ш§Щ„ЪҜЩҲШұЫҢШӘЩ… ЩҫШұЩҶШҜЪҜШ§ЩҶ ЩҲ Ъ©Щ„ЩҲЩҶЫҢ Щ…ЩҲШұЪҶЪҜШ§ЩҶ ЩҲ ШәЫҢШұЩҮ Щ…ЫҢ ШЁШ§ШҙШҜ. Ш§ШІ Ш¬ЩҮШӘ Ъ©Ш§ШұШЁШұШҜ ЩҶЫҢШІ ШӘШ§ Ъ©ЩҶЩҲЩҶ ШҜШұ ШӯЩ„ Щ…ШіШ§ШҰЩ„ ШІЫҢШ§ШҜЫҢ ШҜШұ ШІЩ…ЫҢЩҶЩҮ ШЁЩҮЫҢЩҶЩҮ ШіШ§ШІЫҢ Ш§ШІ Ш¬Щ…Щ„ЩҮ ШҜШұ Щ…ЩҮЩҶШҜШіЫҢ ШЁШұЩӮШҢ Ъ©Ш§Щ…ЩҫЫҢЩҲШӘШұШҢ ШөЩҶШ§ЫҢШ№ШҢ Щ…Ъ©Ш§ЩҶЫҢЪ©ШҢ Ш§ЩӮШӘШөШ§ШҜШҢ Щ…ШҜЫҢШұЫҢШӘ ЩҲ ... Ш§ШіШӘЩҒШ§ШҜЩҮ ШҙШҜЩҮ Ш§ШіШӘ. ШҜЩ„ЫҢЩ„ Ш§ШіШӘЩӮШЁШ§Щ„ ШЁШ§Щ„Ш§ Ш§ШІ Ш§ЫҢЩҶ Ш§Щ„ЪҜЩҲШұЫҢШӘЩ… ШҜШұ Ъ©ЩҶШ§Шұ Ъ©Ш§ШұШ§ЫҢЫҢ ШЁШ§Щ„Ш§ЫҢ ШўЩҶШҢ ШЁЫҢШҙШӘШұ ШЁЩҮ Ш¬ЩҶШЁЩҮ ЩҶЩҲШўЩҲШұЫҢ ЩҲ Ш¬ШҜЫҢШҜ ЩҲ Ш¬Ш°Ш§ШЁ ШЁЩҲШҜЩҶ ШўЩҶ ШЁШұШ§ЫҢ Щ…ШӘШ®ШөШөЫҢЩҶ ШӯЩҲШІЩҮ ШЁЩҮЫҢЩҶЩҮ ШіШ§ШІЫҢ ШЁШұ Щ…ЫҢ ЪҜШұШҜШҜ. ШҙЪ©Щ„ ШІЫҢШұ ШұЩҲЩҶШҜ Ш§Ш№Щ…Ш§Щ„ Ш§Щ„ЪҜЩҲШұЫҢШӘЩ… ШұЩӮШ§ШЁШӘ Ш§ШіШӘШ№Щ…Ш§ШұЫҢ ШЁЩҮ ЫҢЪ© Щ…ШіШҰЩ„ЩҮ ШЁЩҮЫҢЩҶЩҮ ШіШ§ШІЫҢ ШҜШұ ШӯШ§Щ„ШӘ Ъ©Щ„ЫҢ ШұШ§ ЩҶШҙШ§ЩҶ Щ…ЫҢ ШҜЩҮШҜ. ЫҢШ§ШҜЪҜЫҢШұЫҢ ШҙШЁЪ©ЩҮ Ш№ШөШЁЫҢ ЩҶЫҢШІ Ъ©ЩҮ ЫҢЪ© Щ…ШіШҰЩ„ЩҮ ШЁЩҮЫҢЩҶЩҮ ШіШ§ШІЫҢ Ш§ШіШӘШҢ ЩҮЩ…ЫҢЩҶ ШұЩҲЩҶШҜ ШұШ§ Ш®ЩҲШ§ЩҮШҜ ШҜШ§ШҙШӘ.  ШҙЪ©Щ„ 5: ШұЩҲЩҶШҜ Ш§Ш№Щ…Ш§Щ„ Ш§Щ„ЪҜЩҲШұЫҢШӘЩ… ШұЩӮШ§ШЁШӘ Ш§ШіШӘШ№Щ…Ш§ШұЫҢ ШЁЩҮ ЫҢЪ© Щ…ШіШҰЩ„ЩҮ ШЁЩҮЫҢЩҶЩҮ ШіШ§ШІЫҢ ШҜШұ ШӯШ§Щ„ШӘ Ъ©Щ„ЫҢ ШўЩ…ЩҲШІШҙ ШҙШЁЪ©ЩҮ Ш№ШөШЁЫҢ ШўЩ…ЩҲШІШҙ ШҙШЁЪ©ЩҮ Ш№ШөШЁЫҢ ЩҮЩ…Ш§ЩҶЪҜЩҲЩҶЩҮ Ъ©ЩҮ ШҜШұ ШЁШ§Щ„Ш§ ЩҶЫҢШІ ШЁШҜШ§ЩҶ Ш§ШҙШ§ШұЩҮ ЪҜШұШҜЫҢШҜШҢ ЩҮЩ…Ш§ЩҶ ШӘШ№ЫҢЫҢЩҶ ЩҲШІЩҶЩҮШ§ЫҢ Щ…ЩҶШ§ШіШЁ ШЁШұШ§ЫҢ ШҙШЁЪ©ЩҮ Ш№ШөШЁЫҢ Ш§ШіШӘ. ШЁШұШ§ЫҢ Ш§ЫҢЩҶ Щ…ЩҶШёЩҲШұ ШЁШ§ЫҢШҜ Ш§ШІ ЫҢЪ© ШұЩҲШҙ ШЁЩҮЫҢЩҶЩҮ ШіШ§ШІЫҢ ЩӮЩҲЫҢ ЩҲ ШіШұЫҢШ№ Ш§ШіШӘЩҒШ§ШҜЩҮ Ъ©ШұШҜ. ШўЩ…ЩҲШІШҙ ШҙШЁЪ©ЩҮ Ш№ШөШЁЫҢ ШЁШ§ Ш§ШіШӘЩҒШ§ШҜЩҮ Ш§ШІ Ш§Щ„ЪҜЩҲШұЫҢШӘЩ… ШұЩӮШ§ШЁШӘ Ш§ШіШӘШ№Щ…Ш§ШұЫҢ (ICA) ШіЩҲШ§Щ„ Ш§ЩҲЩ„: ЪҶШұШ§ ШўЩ…ЩҲШІШҙ ШҙШЁЪ©ЩҮ Ш№ШөШЁЫҢ ШЁШ§ Ш§ШіШӘЩҒШ§ШҜЩҮ Ш§ШІ Ш§Щ„ЪҜЩҲШұЫҢШӘЩ… ЩҮШ§ЫҢ ШӘЪ©Ш§Щ…Щ„ЫҢШҹ Ш§ШІ ШұЩҲЫҢ Ш§ЫҢЩҶ ШіЩҲШ§Щ„ Ш®ЫҢЩ„ЫҢ Ш§ШІ Щ…ЩҲШ§ШұШҜ ШЁШҜЩҲЩҶ ЩҫШұШіЫҢШҜЩҶ ШўЩҶШҢ ШұШҜ Щ…ЫҢ ШҙЩҲЫҢЩ…. Ш§Щ…Ш§ Ш§ШӘЩҒШ§ЩӮШ§ЩӢ Ш§ЫҢЩҶ Щ…ЩҮЩ… ШӘШұЫҢЩҶ ШіЩҲШ§Щ„ Ш§ШіШӘ. ЪҶШұШ§ ШҜШұ Ъ©ЩҶШ§Шұ ЩҲШ¬ЩҲШҜ Ш§Щ„ЪҜЩҲШұЫҢШӘЩ… ЩҮШ§ЫҢ ШЁЩҮЫҢЩҶЩҮ ШіШ§ШІЫҢ Щ…ШЁШӘЩҶЫҢ ШЁШұ ЪҜШұШ§ШҜЫҢШ§ЩҶ (Gradient-Based Methods) Ъ©ЩҮ Ш§Щ„ЪҜЩҲШұЫҢШӘЩ…ЫҢ Щ…Ш«Щ„ ЩҫШі Ш§ЩҶШӘШҙШ§Шұ Ш®Ш·Ш§ (Error Back-Propagation) Ш§ШІ ШўЩҶ ЩҮШ§ Ш§ШіШӘШ®ШұШ§Ш¬ Щ…ЫҢ ШҙЩҲШҜ ЩҲ Ш®ЫҢЩ„ЫҢ ШіШұЫҢШ№ ЩҮЩ… ЩҮШіШӘШҢ ШЁШ§ЫҢШҜ ШЁШұЩҲЫҢЩ… ШіШұШ§Шә ШұЩҲШҙЩҮШ§ЫҢ ШӘЪ©Ш§Щ…Щ„ЫҢ Щ…Ш«Щ„ Ш§Щ„ЪҜЩҲШұЫҢШӘЩ… ICAШҹ ШЁЫҢШ§ЫҢЫҢШҜ Щ…ШІШ§ЫҢШ§ ЩҲ Щ…Ш№Ш§ЫҢШЁ ЩҮШұ ШұЩҲШҙ ШұШ§ ШЁШұШұШіЫҢ Ъ©ЩҶЫҢЩ…. Ш§Щ„ЪҜЩҲШұЫҢШӘЩ… ЩҮШ§ЫҢ ШЁЩҮЫҢЩҶЩҮ ШіШ§ШІЫҢ Щ…ШЁШӘЩҶЫҢ ШЁШұ ЪҜШұШ§ШҜЫҢШ§ЩҶ ЩҲ Ш§Щ„ЪҜЩҲШұЫҢШӘЩ… ЩҫШі Ш§ЩҶШӘШҙШ§Шұ Ш®Ш·Ш§ (BP) Ш®ЫҢЩ„ЫҢ ШіШұЫҢШ№ ЩҮШіШӘЩҶШҜ. Ш§Щ„ЪҜЩҲШұЫҢШӘЩ… ЩҮШ§ЫҢ ШЁЩҮЫҢЩҶЩҮ ШіШ§ШІЫҢ Щ…ШЁШӘЩҶЫҢ ШЁШұ ЪҜШұШ§ШҜЫҢШ§ЩҶ ЩҲ Ш§Щ„ЪҜЩҲШұЫҢШӘЩ… ЩҫШі Ш§ЩҶШӘШҙШ§Шұ Ш®Ш·Ш§ (BP) Щ…ШҙЪ©Щ„ Ш§ЩҒШӘШ§ШҜЩҶ ШҜШұ ШҜШ§Щ… Щ…ЫҢЩҶЫҢЩ…Щ… Щ…ШӯЩ„ЫҢ ШұШ§ ШҜШ§ШұЩҶШҜ. Ш§Щ„ЪҜЩҲШұЫҢШӘЩ… ЩҮШ§ЫҢ ШЁЩҮЫҢЩҶЩҮ ШіШ§ШІЫҢ Щ…ШЁШӘЩҶЫҢ ШЁШұ ЪҜШұШ§ШҜЫҢШ§ЩҶ ЩҲ Ш§Щ„ЪҜЩҲШұЫҢШӘЩ… ЩҫШі Ш§ЩҶШӘШҙШ§Шұ Ш®Ш·Ш§ (BP) ЩҒЩӮШ· ШЁЩҮ ШҜШіШӘЩҮ Ш§ЫҢ Ш®Ш§Шө ЩҲ Ш§ШіШӘШ§ЩҶШҜШ§ШұШҜ Ш§ШІ ШҙШЁЪ©ЩҮ ЩҮШ§ЫҢ Ш№ШөШЁЫҢ Щ…Ш«Щ„ ЩҫШұШіЩҫШӘШұЩҲЩҶ ЪҶЩҶШҜ Щ„Ш§ЫҢЩҮ (BP) ЩҲ ШўШұ ШЁЫҢ Ш§ЩҒ Ъ©ЩҮ ШӯЩ„ ШЁШіШӘЩҮ ШЁШұШ§ЫҢ Щ…ШҙШӘЩӮ ШӘШ§ШЁШ№ ЩҮШҜЩҒ ЩҶШіШЁШӘ ШЁЩҮ ЩҲШІЩҶЩҮШ§ ШұШ§ ШҜШ§ШұЩҶШҜШҢ ЩӮШ§ШЁЩ„ Ш§Ш№Щ…Ш§Щ„ ЩҮШіШӘЩҶШҜ. Ш§Щ„ЪҜЩҲШұЫҢШӘЩ… ЩҮШ§ЫҢ ШЁЩҮЫҢЩҶЩҮ ШіШ§ШІЫҢ ШӘЪ©Ш§Щ…Щ„ЫҢ ШҜШұ Щ…ЩӮШ§ЫҢШіЩҮ ШЁШ§ Ш§Щ„ЪҜЩҲШұЫҢШӘЩ… ЩҮШ§ЫҢ Щ…ШЁШӘЩҶЫҢ ШЁШұ ЪҜШұШ§ШҜЫҢШ§ЩҶ Ъ©ЩҶШҜ ЩҮШіШӘЩҶШҜ. Ш§Щ„ЪҜЩҲШұЫҢШӘЩ… ЩҮШ§ЫҢ ШЁЩҮЫҢЩҶЩҮ ШіШ§ШІЫҢ ШӘЪ©Ш§Щ…Щ„ЫҢ ЩӮШ§ШЁЩ„ЫҢШӘ ЩҒШұШ§Шұ Ш§ШІ ШҜШ§Щ… Щ…ШӯЩ„ЫҢ ШұШ§ ШҜШ§ШұЩҶШҜ. Ш§Щ„ЪҜЩҲШұЫҢШӘЩ… ЩҮШ§ЫҢ ШЁЩҮЫҢЩҶЩҮ ШіШ§ШІЫҢ ШӘЪ©Ш§Щ…Щ„ЫҢ ЩҲШ§ШЁШіШӘЩҮ ШЁЩҮ ШіШ§Ш®ШӘШ§Шұ Ш®Ш§ШөЫҢ Ш§ШІ ШҙШЁЪ©ЩҮ ЩҶЫҢШіШӘЩҶШҜ ЩҲ ШЁЩҮ ЩҮШұ ШіШ§Ш®ШӘШ§Шұ ШӘШ№ШұЫҢЩҒ ШҙШҜЩҮ Ш§ЫҢ ЩӮШ§ШЁЩ„ Ш§Ш№Щ…Ш§Щ„ ЩҮШіШӘЩҶШҜ. ШЁЩҮ ШәЫҢШұ Ш§ШІ ШӘШ№ЫҢЫҢЩҶ ЩҲШІЩҶЩҮШ§ (ЫҢШ§ШҜЪҜЫҢШұЫҢ ШҙШЁЪ©ЩҮ Ш№ШөШЁЫҢ) Щ…ЫҢ ШӘЩҲШ§ЩҶ ЩҮЩ…ШІЩ…Ш§ЩҶ ШіШ§Ш®ШӘШ§Шұ ШҙШЁЪ©ЩҮ (ШӘШ№ШҜШ§ШҜ Щ„Ш§ЫҢЩҮ ЩҮШ§ ЩҲ ШӘШ№ШҜШ§ШҜ ЩҶШұЩҲЩҶЩҮШ§ ШҜШұ ЩҮШұ Щ„Ш§ЫҢЩҮ) ШұШ§ ЩҶЫҢШІ ШӘЩҲШіШ· Ш§Щ„ЪҜЩҲШұЫҢШӘЩ… ЩҮШ§ЫҢ ШЁЩҮЫҢЩҶЩҮ ШіШ§ШІЫҢ ШӘЪ©Ш§Щ…Щ„ЫҢ Щ…Ш«Щ„ Ш§Щ„ЪҜЩҲШұЫҢШӘЩ… ШұЩӮШ§ШЁШӘ Ш§ШіШӘШ№Щ…Ш§ШұЫҢ ЫҢШ§ШҜ ЪҜШұЩҒШӘ. ЩҫШі Ш§ШіШӘЩҒШ§ШҜЩҮ Ш§ШІ Ш§Щ„ЪҜЩҲШұЫҢШӘЩ… ЩҮШ§ЫҢ ШӘЪ©Ш§Щ…Щ„ЫҢ ШҜШұ ШҙШЁЪ©ЩҮ Ш№ШөШЁЫҢ Щ…ШІЫҢШӘ ЩҒШұШ§Шұ Ш§ШІ ЩҶЩӮШ§Ш· Щ…ЫҢЩҶЫҢЩ…Щ… Щ…ШӯЩ„ЫҢ ЩҲ ЩҶЫҢШІ Ш№ШҜЩ… ЩҲШ§ШЁШіШӘЪҜЫҢ ШЁЩҮ ШіШ§Ш®ШӘШ§Шұ Щ…Ш№ЫҢЩҶ ШҙШЁЪ©ЩҮ ШұШ§ ШҜШ§ШұШҜ. Ш§Щ…Ш§ ШҜШұ Ш№ЩҲШ¶ Ш§ЫҢЩҶ Ш§Щ„ЪҜЩҲШұЫҢШӘЩ… ЩҮШ§ Ъ©ЩҶШҜ Щ…ЫҢ ШЁШ§ШҙЩҶШҜ. Ш§Щ„ШЁШӘЩҮ Ъ©ЩҶШҜ ШЁЩҲШҜЩҶ ШЁШӯШ« ШЁШіЫҢШ§Шұ Щ…ЩҮЩ…ЫҢ Ш§ШіШӘ ЩҲ ШЁЩҮ ЩҮЩ…ЫҢЩҶ ШіШ§ШҜЪҜЫҢ ЩҶЩ…ЫҢ ШӘЩҲШ§ЩҶ Ш§ШІ ШўЩҶ Ш№ШЁЩҲШұ Ъ©ШұШҜ. ШҜШұ Щ…ЩҲШ§ШұШҜЫҢ Ъ©ЩҶШҜ ШЁЩҲШҜЩҶ Ш§ЫҢЩҶ ШұЩҲШҙЩҮШ§ ШіШ§ЫҢШұ Щ…ШІЫҢШӘ ЩҮШ§ЫҢ Ш§Щ„ЪҜЩҲШұЫҢШӘЩ… ШұШ§ ШІЫҢШұ ШіЩҲШ§Щ„ Щ…ЫҢ ШЁШұШҜ. ШҜШұ Щ…ЩҲШұШҜ ШҙШЁЪ©ЩҮ Ш№ШөШЁЫҢ ЩҶЫҢШІ ЩҮЩ…ЫҢЩҶ ЪҜЩҲЩҶЩҮ Ш§ШіШӘ. Ш§ШіШӘЩҒШ§ШҜЩҮ Ш§ШІ Ш§Щ„ЪҜЩҲШұЫҢШӘЩ… ЩҮШ§ЫҢ ШӘЪ©Ш§Щ…Щ„ЫҢ ШҜШұ Щ…ЩҲШұШҜ ШҙШЁЪ©ЩҮ ЩҮШ§ЫҢ Ш№ШөШЁЫҢ Ш§ШіШӘШ§ЩҶШҜШ§ШұШҜ (ШҜШұ Ъ©ЩҶШ§Шұ ЩҲШ¬ЩҲШҜ ШұЩҲШҙЩҮШ§ЫҢ Щ…ШЁШӘЩҶЫҢ ШЁШұ ЪҜШұШ§ШҜЫҢШ§ЩҶ ШіШұЫҢШ№) Ш®ЫҢЩ„ЫҢ ШӘЩҲШ¬ЫҢЩҮ ЩҫШ°ЫҢШұ ЩҶЫҢШіШӘ. Ш§Щ„ШЁШӘЩҮ Ш§ЪҜШұ ШІЩ…Ш§ЩҶ Ъ©Ш§ЩҒЫҢ ШҜШ§ШҙШӘЩҮ ШЁШ§ШҙЫҢЩ… (Щ…ЫҢЩ„ ШҜШ§ШҜЩҶ ШІЩ…Ш§ЩҶ ШЁЩҮ ШЁЫҢЩҶЩҮШ§ЫҢШӘ) Ш§ШіШӘЩҒШ§ШҜЩҮ Ш§ШІ Ш§Щ„ЪҜЩҲШұЫҢШӘЩ… ЩҮШ§ЫҢ ШӘЪ©Ш§Щ…Щ„ЫҢ Щ…Ш№Щ…ЩҲЩ„Ш§ЩӢ ШЁЩҮ Ш¬ЩҲШ§ШЁ ШЁЩҮШӘШұЫҢ ЩҶШіШЁШӘ ШЁЩҮ Ш§Щ„ЪҜЩҲШұЫҢШӘЩ… ЩҮШ§ЫҢ Щ…ШЁШӘЩҶЫҢ ШЁШұ ЪҜШұШ§ШҜЫҢШ§ЩҶ Ш®ШӘЩ… Ш®ЩҲШ§ЩҮШҜ ШҙШҜ. Ш§Щ…Ш§ ШҜШұ Ш№Щ…Щ„ Ш§ЫҢЩҶ ЪҜЩҲЩҶЩҮ ЩҶЫҢШіШӘ ЩҲ Щ…Ш§ ЩҶЩ…ЫҢ ШӘЩҲШ§ЩҶЫҢЩ… Щ…Ш«Щ„Ш§ЩӢ ЫҢЪ© ЩҮЩҒШӘЩҮ ШЁШұШ§ЫҢ ЫҢШ§ШҜЪҜЫҢШұЫҢ ЫҢЪ© ШҙШЁЪ©ЩҮ Ш№ШөШЁЫҢ ЩҲЩӮШӘ ШЁЪҜШ°ШұШ§ЫҢЩ… ЩҲЩӮШӘЫҢ Ъ©ЩҮ ШұЩҲШҙ ЩҫШі Ш§ЩҶШӘШҙШ§Шұ Ш®Ш·Ш§ ШҜШұ ШӯШҜЩҲШҜ ЫҢЪ©ЫҢ ШҜЩҲ ШіШ§Ш№ШӘ ШўЩҶ ШұШ§ ШӯЩ„ Щ…ЫҢ Ъ©ЩҶШҜ (ШӯШӘЫҢ Ш§ЪҜШұ ШЁЩҮ Ш¬ЩҲШ§ШЁ Ъ©Щ…ЫҢ Ш¶Ш№ЫҢЩҒ ШӘШұ ШЁШұШіШҜ). Ш§Щ…Ш§ ЩҫШұЩҲЩҶШҜЩҮ Ш§ШіШӘЩҒШ§ШҜЩҮ Ш§ШІ Ш§Щ„ЪҜЩҲШұЫҢШӘЩ… ЩҮШ§ЫҢ ШӘЪ©Ш§Щ…Щ„ЫҢ ШҜШұ ЫҢШ§ШҜЪҜЫҢШұЫҢ ШҙШЁЪ©ЩҮ Ш№ШөШЁЫҢ ШұШ§ ЩҶШЁШ§ЫҢШҜ ШЁШіШӘЩҮ ЩҒШұШ¶ Ъ©ШұШҜ. ШҙШЁЪ©ЩҮ ЩҮШ§ЫҢ Ш№ШөШЁЫҢ ШІЫҢШ§ШҜЫҢ Щ…Ш·ШұШӯ Щ…ЫҢ ШҙЩҲЩҶШҜ Ъ©ЩҮ ШіШ§Ш®ШӘШ§ШұЫҢ ШҜШ§ШұЩҶШҜ Ъ©ЩҮ ЩҶШёЩ… Ъ©Ш§ЩҒЫҢ ШЁШұШ§ЫҢ ЪҜШұЩҒШӘЩҶ Щ…ШҙШӘЩӮШ§ШӘ Щ…ЩҲШұШҜ Ш§ШіШӘЩҒШ§ШҜЩҮ ШҜШұ ШұЩҲШҙЩҮШ§ЫҢ Щ…ШЁШӘЩҶЫҢ ШЁШұ ЪҜШұШ§ШҜЫҢШ§ЩҶ ШұШ§ ЩҶШҜШ§ШҙШӘЩҮ ЩҲ ШЁЩҶШ§ШЁШұШ§ЫҢЩҶ ШұЩҲШҙЩҮШ§ЫҢЫҢ Щ…Ш«Щ„ ЩҫШі Ш§ЩҶШӘШҙШ§Шұ Ш®Ш·Ш§ ЩӮШ§ШЁЩ„ Ш§Ш№Щ…Ш§Щ„ ЩҶЫҢШіШӘЩҶШҜ. Ш§ЫҢЩҶШ¬Ш§ШіШӘ Ъ©ЩҮ Ш§Щ„ЪҜЩҲШұЫҢШӘЩ… ЩҮШ§ЫҢ ШӘЪ©Ш§Щ…Щ„ЫҢ ЩҲ ШҜШұ Ъ©ЩҶШ§Шұ ШўЩҶЩҮШ§ШҢ Ш§Щ„ЪҜЩҲШұЫҢШӘЩ… ШұЩӮШ§ШЁШӘ Ш§ШіШӘШ№Щ…Ш§ШұЫҢ ШЁШ§ЫҢШҜ Щ…ЩҲШұШҜ Ш§ШіШӘЩҒШ§ШҜЩҮ ЩӮШұШ§Шұ ЪҜЫҢШұЩҶШҜ. ШіЩҲШ§Щ„ ШҜЩҲЩ…: ЪҶШұШ§ Ш§Щ„ЪҜЩҲШұЫҢШӘЩ… ШұЩӮШ§ЫҢШӘ Ш§ШіШӘШ№Щ…Ш§ШұЫҢШҹ Ш§Щ„ЪҜЩҲШұЫҢШӘЩ… ШұЩӮШ§ЫҢШӘ Ш§ШіШӘШ№Щ…Ш§ШұЫҢ (ICA) ШҜШұ Ъ©ЩҶШ§Шұ ШұЩҲШҙЩҮШ§ЫҢ ШҜЫҢЪҜШұ ШЁЩҮЫҢЩҶЩҮ ШіШ§ШІЫҢ ШЁЩҮ Ш№ЩҶЩҲШ§ЩҶ Ш§ШЁШІШ§Шұ ЩҶЩҲЫҢЩҶЫҢ ШЁШұШ§ЫҢ Щ…ШӯШ§ШіШЁШ§ШӘ ШӘЪ©Ш§Щ…Щ„ЫҢ ЩҲ ШӯЩ„ Щ…ШіШ§ШҰЩ„ ШЁЩҮЫҢЩҶЩҮ ШіШ§ШІЫҢ Щ…Ш·ШұШӯ ШҙШҜЩҮ ЩҲ ШЁШ§ Щ…ЩҲЩҒЩӮЫҢШӘ ШЁЩҮ ШЁШіЫҢШ§ШұЫҢ Ш§ШІ Щ…ШіШ§ШҰЩ„ ШҜШұ Ш§ЫҢЩҶ ШӯЩҲШІЩҮ Ш§Ш№Щ…Ш§Щ„ ШҙШҜЩҮ Ш§ШіШӘ. Ш§Ъ©Ш«Шұ Щ…ЩӮШ§Щ„Ш§ШӘ Щ…ЩҶШӘШҙШұ ШҙШҜЩҮ (ШЁШ№Ш¶ЫҢ Ш§ШІ ШўЩҶЩҮШ§ ШұШ§ ШҜШұ Ш§ЫҢЩҶ Щ„ЫҢЩҶЪ© ШЁШЁЫҢЩҶЫҢШҜ) ЩҶЫҢШІ Ш§ШІ Щ…ЩҲЩҒЩӮЫҢШӘ ЩҲ ШЁШұШӘШұЫҢ ЩҶШіШЁЫҢ Ш§ЫҢЩҶ Ш§Щ„ЪҜЩҲШұЫҢШӘЩ… ШӯЪ©Ш§ЫҢШӘ Ъ©ШұШҜЩҮ Ш§ЩҶШҜ. ЩҫЫҢШ§ШҜЩҮ ШіШ§ШІЫҢ ЩҲ ШЁШұЩҶШ§Щ…ЩҮ ЩҶЩҲЫҢШіЫҢ Ш№Щ…Щ„ЫҢ ШўЩ…ЩҲШІШҙ ШҙШЁЪ©ЩҮ Ш№ШөШЁЫҢ ШҜШұ Щ…ШӘЩ„ШЁ: ШЁШ®Шҙ ЩҮШ§ЫҢ Щ…Ш®ШӘЩ„ЩҒ Ъ©ШҜ Щ…ЩҲШұШҜ Ш§ШіШӘЩҒШ§ШҜЩҮ ШЁШұШ§ЫҢ ЫҢШ§ШҜЪҜЫҢШұЫҢ ШҙШЁЪ©ЩҮ Ш№ШөШЁЫҢ ШұШ§ ШҜШұ ШІЫҢШұ Щ…ЫҢ ШЁЫҢЩҶЫҢЩ…. Ш§ЫҢЩҶ Ъ©ШҜЩҮШ§ Ш§ШІ ШҜШіШӘЩҲШұШ§ШӘ ШӘЩҲЩ„ШЁШ§Ъ©Ші ШҙШЁЪ©ЩҮ Ш№ШөШЁЫҢ Щ…ШӘЩ„ШЁ Ш§ШіШӘЩҒШ§ШҜЩҮ Щ…ЫҢ Ъ©ЩҶЩҶШҜ. ШЁЩҮ ШІЩҲШҜЫҢ ЩҒЫҢЩ„Щ… Ш¬Ш§Щ…Ш№ЫҢ ШҜШұ Щ…ЩҲШұШҜ ШўЩ…ЩҲШІШҙ Ш№Щ…Щ„ЫҢ ШЁШұЩҶШ§Щ…ЩҮ ЩҶЩҲЫҢШіЫҢ ШҙШЁЪ©ЩҮ Ш№ШөШЁЫҢ ШҜШұ Щ…ШӘЩ„ШЁ ШҜШұ ЩҮЩ…ЫҢЩҶ ЩҲШЁШіЫҢШ§ШӘ Ш№ШұШ¶ЩҮ Ш®ЩҲШ§ЩҮШҜ ШҙШҜ. ЩҮЩ…ЪҶЩҶЫҢЩҶ ШҜШұ Ш§ЫҢЩҶ Щ„ЫҢЩҶЪ© ЩҒШ§ЫҢЩ„ЩҮШ§ЫҢ ШўЩ…ЩҲШІШҙЫҢ Щ…Ъ©Ш§ШӘШЁЩҮ Ш§ЫҢ Ш§ШІ Щ…ШӘЩ„ШЁШіШ§ЫҢШӘ ЩӮШ§ШЁЩ„ ШӘЩҮЫҢЩҮ ЩҮШіШӘЩҶШҜ. ШЁШ®Шҙ ЩҮШ§ЫҢ Щ…Ш®ШӘЩ„ЩҒ ЫҢЪ© ШЁШұЩҶШ§Щ…ЩҮ ШҙШЁЪ©ЩҮ Ш№ШөШЁЫҢ ШұШ§ ШЁШ§ ЩҮЩ… Щ…ШұЩҲШұ Щ…ЫҢ Ъ©ЩҶЫҢЩ…. ЩғШҜ:

ЩғШҜ:

%% Data generation or loading ЩғШҜ:

%% Data Normalization ЩғШҜ:

%% Train and Test Data ЩғШҜ:

TrPercent = 80; TrNum = round(TrPercent/100 * DataNum); R = randperm(DataNum); TrIndex = R(1:TrNum); TsIndex = R(TrNum+1:end); Xtr = XN(TrIndex,:); Xts = XN(TsIndex,:); Ytr = YN(TrIndex,:); Yts = YN(TsIndex,:); %% Network Structure ШіШ§Ш®ШӘШ§Шұ ШҙШЁЪ©ЩҮ ШҜШұ Ш§ЫҢЩҶ ШЁШ®Шҙ Ш§ЫҢШ¬Ш§ШҜ Щ…ЫҢ ШҙЩҲШҜ. Щ…Ш№Щ…ЩҲЩ„Ш§ЩӢ Ш§ШІ ШҜШіШӘЩҲШұ newff ШҜШұ Щ…ШӘЩ„ШЁ Ш§ШіШӘЩҒШ§ШҜЩҮ Щ…ЫҢ Ъ©ЩҶЫҢЩ…. Щ…Ш«Ш§Щ„ ШІЫҢШұ ШұШ§ ШЁШЁЫҢЩҶЫҢШҜ. ЩғШҜ:

pr = [-1 1];

PR = repmat(pr,InputNum,1);

Network = newff(PR, [10 5 1],{'tansig' 'tansig' 'purelin'});

Network.trainParam.epochs = 100;

Network.trainParam.goal = 0.0001;

%% Network Training

ЩғШҜ:

Network = train(Network,Xtr',Ytr'); %% Network Assessment ШҙШЁЪ©ЩҮ ШўЩ…ЩҲШІШҙ ШҜЫҢШҜЩҮ ШұШ§ Ш§ШұШІЫҢШ§ШЁЫҢ Щ…ЫҢ Ъ©ЩҶЫҢЩ…. ЩғШҜ:

%% Network Analysis and Display ЩғШҜ:

%% End of Program ШЁШұШ§ЫҢ Ш§ШіШӘЩҒШ§ШҜЩҮ Ш§ШІ Ш§Щ„ЪҜЩҲШұЫҢШӘЩ… ШұЩӮШ§ШЁШӘ Ш§ШіШӘШ№Щ…Ш§ШұЫҢ ШЁШұШ§ЫҢ ШўЩ…ЩҲШІШҙ ШҙШЁЪ©ЩҮ Ш№ШөШЁЫҢ ЪҶЩҮ ШЁШ§ЫҢШҜ Ъ©ШұШҜШҹ Щ…Ш§ ШіШ№ЫҢ Щ…ЫҢ Ъ©ЩҶЫҢЩ… Ш§ШІ ШіШ§Ш®ШӘШ§Шұ ШҙШЁЪ©ЩҮ ШұШ§ ШЁШ§ ШҜШіШӘЩҲШұ newff Ш§ЫҢШ¬Ш§ШҜ Ъ©ЩҶЫҢЩ…. ЩҲЩ„ЫҢ ШҜШұ Ъ©Щ„ Щ…ЫҢ ШӘЩҲШ§ЩҶ ШЁШұЩҶШ§Щ…ЩҮ ШұШ§ Ш§ШІ Ш§ЩҲЩ„ ШЁШҜЩҲЩҶ Ш§ШіШӘЩҒШ§ШҜЩҮ Ш§ШІ ШҜШіШӘЩҲШұШ§ШӘ ШӘЩҲЩ„ШЁШ§Ъ©Ші ЩҶЫҢШІ ЩҶЩҲШҙШӘ. ШӘШ§ШЁШ№ ЩҮШІЫҢЩҶЩҮ ЩҮЩ…Ш§ЩҶ ШіШ§Ш®ШӘШ§Шұ Ъ©ШҜ ШЁШ§Щ„Ш§ ШұШ§ ШҜШұЩҶШёШұ ШЁЪҜЫҢШұЫҢШҜ. ШҜШұ ШўЩҶШ¬Ш§ ШҜШұ ШҜШұШіШӘЩҲШұ ШІЫҢШұ ШіШ§Ш®ШӘШ§Шұ ШҙШЁЪ©ЩҮ Ш§ЫҢШ¬Ш§ШҜ ШҙШҜ. ЩғШҜ:

Network = newff(PR, [10 5 1],{'tansig' 'tansig' 'purelin'});

ШұЩҲЫҢ Ш§ЫҢЩҶ ШіШ§Ш®ШӘШ§Шұ ШҜШұ workspace Щ…ШӘЩ„ШЁ Ъ©Щ„ЫҢЪ© Ъ©ЩҶЫҢШҜ. ШӘЩ…Ш§Щ… ШӘЩҶШёЫҢЩ…Ш§ШӘ ШҙШЁЪ©ЩҮ ШұШ§ Ш®ЩҲШ§ЩҮЫҢШҜ ШҜЫҢШҜ. ШіШ№ЫҢ Ъ©ЩҶЫҢШҜ Щ…ШӯЩ„ Ш°Ш®ЫҢШұЩҮ ШҙШҜЩҶ ЩҲШІЩҶ ЩҮШ§ЫҢ ШҙШЁЪ©ЩҮ Ш№ШөШЁЫҢ ШұШ§ ЩҫЫҢШҜШ§ Ъ©ШұШҜЩҮ ЩҲ ШЁЩҮ ШўЩҶЩҮШ§ ШҜШіШӘШұШіЫҢ ЩҫЫҢШҜШ§ Ъ©ЩҶЫҢШҜ. ШҙЩ…Ш§ ШЁШ§ЫҢШҜ ШЁШӘЩҲШ§ЩҶЫҢШҜ Ш§ЫҢЩҶ ЩҲШІЩҶЩҮШ§ЫҢ Ш§ЩҲЩ„ЫҢЩҮ ШӘШөШ§ШҜЩҒЫҢ ШұШ§ ШҜШіШӘЪ©Ш§ШұЫҢ Ъ©ЩҶЫҢШҜ. ШӘШ§ШЁШ№ ЩҮШІЫҢЩҶЩҮ ШҙЩ…Ш§ ШЁЩҮ Ш§ЫҢЩҶ ШөЩҲШұШӘ Ш®ЩҲШ§ЩҮШҜ ШЁЩҲШҜ. ЩғШҜ:

function Cost = ICA_CostFunction_Fcn(Country,Network); Ш§ШІ ШұШҙШӘЩҮ Ш·ЩҲЩ„Ш§ЩҶЫҢ Country ШЁЩҮ ШӘШұШӘЫҢШЁ Ъ©ШҜЫҢЩҶЪҜЫҢ Ъ©ЩҮ Ш®ЩҲШҜ Ш§ЩҶШӘШ®Ш§ШЁ Ъ©ШұШҜЩҮ Ш§ЫҢШҜШҢ ЩҲШІЩҶ Щ„Ш§ЫҢЩҮ ЩҮШ§ЫҢ Щ…Ш®ШӘЩ„ЩҒ ШұШ§ Ш¬ШҜШ§ Ъ©ЩҶЫҢШҜ. ЩғШҜ:

[W U V , вҖҰ] = GetNetworkWeightsFromCountry_Fcn(Country); Ш§ЫҢЩҶ ЩҲШІЩҶЩҮШ§ ШұШ§ ШҜШұ Щ…ШӯЩ„ ЩҮШ§ЫҢ Щ…ЩҶШ§ШіШЁШҙШ§ЩҶ ШҜШұ Network ЩӮШұШ§ШұШҜШ§ШҜЩҮ ЩҲ ШҜЫҢШӘШ§ЫҢ ЩҲШұЩҲШҜЫҢ Ш§Щ…ЩҲШІШҙ ШұШ§ ШЁШ§ Ш§ШіШӘЩҒШ§ШҜЩҮ Ш§ШІ ШҜШіШӘЩҲШұ sim Щ…ШӘЩ„ШЁ ШЁЩҮ Network ШҜШ§ШҜЩҮ ЩҲ Ш®ШұЩҲШ¬ЫҢ Ш§ЩҶ ШұШ§ ЪҜШұЩҒШӘЩҮ ЩҲ ШЁШ§ Ш®ШұЩҲШ¬ЫҢ ЩҲШ§ЩӮШ№ЫҢ ШӘШіШӘ Щ…ЩӮШ§ЫҢШіЩҮ Ъ©ШұШҜЩҮ ЩҲ ШЁШұЪҜШұШҜШ§ЩҶЫҢШҜ. ЩғШҜ:

Network2 = Change Network With W U V вҖҰ Load TrainData_X Load TrainData_Y NetOut = sim(Network2,TrainData_X) Cost = mse(NetOut, TrainData_Y) end ШўЩ…ЩҲШІШҙ ШҙШЁЪ©ЩҮ ШӯШ§Щ„ ШЁШ§ЫҢШҜ ШҙШЁЪ©ЩҮ ШұШ§ ШўЩ…ЩҲШІШҙ ШҜЩҮЫҢЩ…. ШЁШҜЩҲЩҶ ШҜШіШӘЪ©Ш§ШұЫҢ Ъ©ШҜЩҮШ§ЫҢ Ш§ЩҲЩ„ЫҢЩҮ ШҜШіШӘЩҲШұ train Щ…ЩҲШұШҜ Ш§ШіШӘЩҒШ§ШҜЩҮ ШҜШұ ШўЩҶЩҮШ§ ШұШ§ ШЁШ§ ЫҢЪ© ШӘШ§ШЁШ№ Ш¬ШҜЫҢШҜ Ъ©ЩҮ Ш®ЩҲШҜЩ…Ш§ЩҶ Щ…ЫҢ ЩҶЩҲЫҢШіЫҢЩ… Ш№ЩҲШ¶ Ъ©ЩҶЫҢШҜ. Ш§ШіЩ… Ш§ЫҢЩҶ ШӘШ§ШЁШ№ ШұШ§ Щ…Ш«Щ„Ш§ЩӢ TrianUsing_ICA_Fcn Щ…ЫҢ ЪҜШ°Ш§ШұЫҢЩ…. ЩғШҜ:

Function TrainedNetwork = TrianUsing_ICA_Fcn(Network,Xtr,Ytr); Ъ©ШҜЩҮШ§ЫҢ ШўЩ…Ш§ШҜЩҮ Ш§Щ„ЪҜЩҲШұЫҢШӘЩ…Ъ© ШұЩӮШ§ШЁШӘ Ш§ШіШӘШ№Щ…Ш§ШұЫҢ (ЫҢШ§ ЩҮШұ Ш§Щ„ЪҜЩҲШұЫҢШӘЩ… ШӘЪ©Ш§Щ…Щ„ЫҢ ШҜЫҢЪҜШұЫҢ) ШұШ§ ШҜШұ ШҜШ§Ш®Щ„ Ш§ЫҢЩҶ ШӘШ§ШЁШ№ ЩӮШұШ§Шұ Щ…ЫҢ ШҜЩҮЫҢЩ…. Ш·ЩҲЩ„ ШұШҙШӘЩҮ ШЁШұШҜШ§Шұ Ъ©ШҙЩҲШұ (ШЁШ№ШҜ ЫҢШ§ ЩҮЩ…Ш§ЩҶ ШӘШ№ШҜШ§ШҜ Щ…ШӘШәЫҢШұЩҮШ§ЫҢ ШЁЩҮЫҢЩҶЩҮ ШіШ§ШІЫҢ) ШұШ§ ШЁШұШ§ШЁШұ ШЁШ§ ШӘШ№ШҜШ§ШҜ Ъ©Щ„ ЩҲШІЩҶЩҮШ§ЫҢ Щ…Ш¬ЩҮЩҲЩ„ ШҙШЁЪ©ЩҮ ШҜШұ ЩҶШёШұ Щ…ЫҢ ЪҜЫҢШұЩ…. ШЁШ§ ШҜШ§ШҙШӘЩҶ ШӘШ§ШЁШ№ ЩҮШІЫҢЩҶЩҮ ШӘШ№ШұЫҢЩҒ ШҙШҜЩҮШҢ Щ…Ш«Щ„ ЩҮШұ Щ…ШіШҰЩ„ЩҮ ШЁЩҮЫҢЩҶЩҮ ШіШ§ШІЫҢ ШҜЫҢЪҜШұЫҢШҢ ШЁЩҮ Ш§ЫҢЩҶ Щ…ШіШҰЩ„ЩҮ ШЁЩҮЫҢЩҶЩҮ ШіШ§ШІЫҢ ЩҶЪҜШ§ЩҮ Ъ©ШұШҜЩҮ ЩҲ Ъ©ШҜЩҮШ§ ШұШ§ ШЁЩҮ ШўЩҶ Ш§Ш№Щ…Ш§Щ„ Щ…ЫҢ Ъ©ЩҶЫҢЩ…. Ш§Щ„ШЁШӘЩҮ Ш§ЫҢЩҶ Ъ©Ш§Шұ ЩҶЫҢШ§ШІ ШЁЩҮ Ъ©Щ…ЫҢ ШӘШәЫҢЫҢШұШ§ШӘ ЩҲ ШЁШ§ШІЫҢ Ъ©ШұШҜЩҶ ШЁШ§ Ъ©ШҜЩҮШ§ ШұШ§ Ш®ЩҲШ§ЩҮШҜ ШҜШ§ШҙШӘ. Ш§ЪҜШұ ШЁЩҮ Ъ©ШҜЩҮШ§ЫҢ Ш§Щ„ЪҜЩҲШұЫҢШӘЩ… ШұЩӮШ§ШЁШӘ Ш§ШіШӘШ№Щ…Ш§ШұЫҢ ШҜШіШӘШұШіЫҢ ЩҶШҜШ§ШұЫҢШҜ ЩҲ ЫҢШ§ ЩҶШӯЩҲЩҮ Ш§ШіШӘЩҒШ§ШҜЩҮ Ш§ШІ ШўЩҶЩҮШ§ ШұШ§ ЩҶЩ…ЫҢ ШҜШ§ЩҶЫҢШҜШҢ Ш§ЫҢЩҶ Щ„ЫҢЩҶЪ© ШұШ§ ШЁШЁЫҢЩҶЫҢШҜ. ЩғШҜ:

BestWeights = FindBestWeightsUsingICA_Fcn(Network,Xtr,Ytr); TrainedNetwork = Modify Network with Best Weights; end Щ…ЩӮШ§Щ„Ш§ШӘ Щ…ЩҶШӘШҙШұ ШҙШҜЩҮ  ШӘШ§ Ъ©ЩҶЩҲЩҶ Щ…ЩӮШ§Щ„Ш§ШӘ Щ…ШӘШ№ШҜШҜЫҢ ШҜШұ Щ…ЩҲШұШҜ Ш§ШіШӘЩҒШ§ШҜЩҮ Ш§ШІ Ш§Щ„ЪҜЩҲШұЫҢШӘЩ… ШұЩӮШ§ШЁШӘ Ш§ШіШӘШ№Щ…Ш§ШұЫҢ ШҜШұ ЫҢШ§ШҜЪҜЫҢШұЫҢ ШҙШЁЪ©ЩҮ Ш№ШөШЁЫҢШҢ Щ…ЩҶШӘШҙШұ ШҙШҜЩҮ Ш§ЩҶШҜ: Title: Neural Network Learning based on Chaotic Imperialist Competitive Algorithm Title: Artificial Neural Network Weights Optimization based on Imperialist Competitive Algorithm Ш№ЩҶЩҲШ§ЩҶ: ШҙШЁЩғЩҮ ЩҮШ§ЩҠ Ш№ШөШЁЩҠ ШӘШұЩғЩҠШЁ ШҙШҜЩҮ ШЁШ§ Ш§Щ„ЪҜЩҲШұЩҠШӘЩ… ШұЩӮШ§ШЁШӘ Ш§ШіШӘШ№Щ…Ш§ШұЩҠ ШЁШұШ§ЩҠ Ш·ШЁЩӮЩҮ ШЁЩҶШҜЩҠ ШҜЩҠШӘШ§ЩҮШ§ЩҠ ШЁШ§ШІШ§Шұ ШЁЩҲШұШі ШӘЩҮШұШ§ЩҶ

__________________

ЩҲЩҠШұШ§ЩҠШҙ ШҙШҜЩҮ ШӘЩҲШіШ· Astaraki; Ы°Ы¶-ЫұЫі-ЫұЫіЫёЫ№ ШҜШұ ШіШ§Ш№ШӘ Ы°Ы¶:Ы°Ыҙ ШЁШ№ШҜ Ш§ШІ ШёЩҮШұ |

|

|

|

| Ш§ШІ Astaraki ШӘШҙЩғШұ ЩғШұШҜЩҮ Ш§ШіШӘ: | ali_darinoos (ЫұЫІ-ЫұЫі-ЫұЫіЫёЫ№) |

| #ADS | |

|

ЩҶШҙШ§ЩҶ ШҜЩҮЩҶШҜЩҮ ШӘШЁЩ„ЫҢШәШ§ШӘ

ШӘШЁЩ„ЩҠШәЪҜШұ

ШӘШ§ШұЩҠШ® Ш№Ш¶ЩҲЩҠШӘ: -

Щ…ШӯЩ„ ШіЩғЩҲЩҶШӘ: -

ШіЩҶ: 2010

ЩҫШіШӘ ЩҮШ§: -

|

|

|

|

|

«

ШұЩҲШҙЩҠ Ш¬ЩҮШӘ ШӘШ·ШЁЩҠЩӮ Ш§Щ…Ш¶Ш§ЩҠ ШЁШұ Ш®Ш· ШЁШ§ Ш§ШіШӘЩҒШ§ШҜЩҮ Ш§ШІ ШЁЩҮЩҠЩҶЩҮ ШіШ§ШІЩҠ ЩғЩ„ЩҲЩҶЩҠ Щ…ЩҲШұЪҶЩҮ

|

Щ…ШҜЩ„ Щ…Ш®ЩҒЩҠ Щ…Ш§ШұЪ©ЩҲЩҒ ЩҲ Ш§Щ„ЪҜЩҲШұЩҠШӘЩ…ЩҮШ§ЫҢ ШўЩ…ЩҲШІШҙ

»

| ЩғШ§ШұШЁШұШ§ЩҶ ШҜШұ ШӯШ§Щ„ ШҜЩҠШҜЩҶ ШӘШ§ЩҫЩҠЪ©: 1 (0 Ш№Ш¶ЩҲ ЩҲ 1 Щ…ЩҮЩ…Ш§ЩҶ) | |

|

|

ШІЩ…Ш§ЩҶ Щ…ШӯЩ„ЩҠ ШҙЩ…Ш§ ШЁШ§ ШӘЩҶШёЩҠЩ… GMT +3.5 ЩҮЩ… Ш§Ъ©ЩҶЩҲЩҶ Ы°Ыҙ:Ы°Ыё ШЁШ№ШҜ Ш§ШІ ШёЩҮШұ Щ…ЩҠШЁШ§ШҙШҜ.

Linear Mode

Linear Mode